Thứ tư, ngày 13/08/2025 08:00 GMT+7

Nhật Hà Thứ tư, ngày 13/08/2025 08:00 GMT+7

Thay vì trò chuyện trực tiếp để giải quyết mâu thuẫn, nhiều người lại chọn giãi bày với chatbot, và chính hành động này vô tình đẩy các mối quan hệ ngoài đời thực dần trở nên rạn nứt, tan vỡ.

ChatGPT học cách làm chồng: Chuyện tưởng đùa nhưng có thật

Trong kỷ nguyên công nghệ, khi mọi câu trả lời đều có thể tìm thấy chỉ sau vài giây gõ phím, con người dần lệ thuộc vào trí tuệ nhân tạo để giải quyết vấn đề cá nhân. Chính điều này khiến đối phương đôi khi cảm thấy bị thay thế, bị bỏ rơi, thậm chí bị phản bội. Từ đó, các mối quan hệ dần trở nên xa cách và rạn vỡ lúc nào không hay.

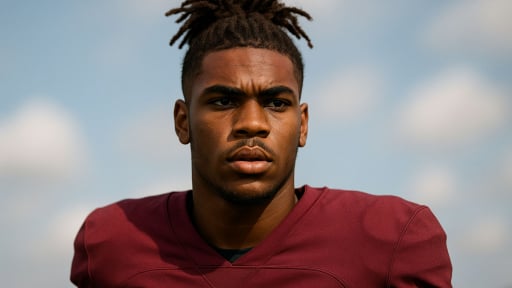

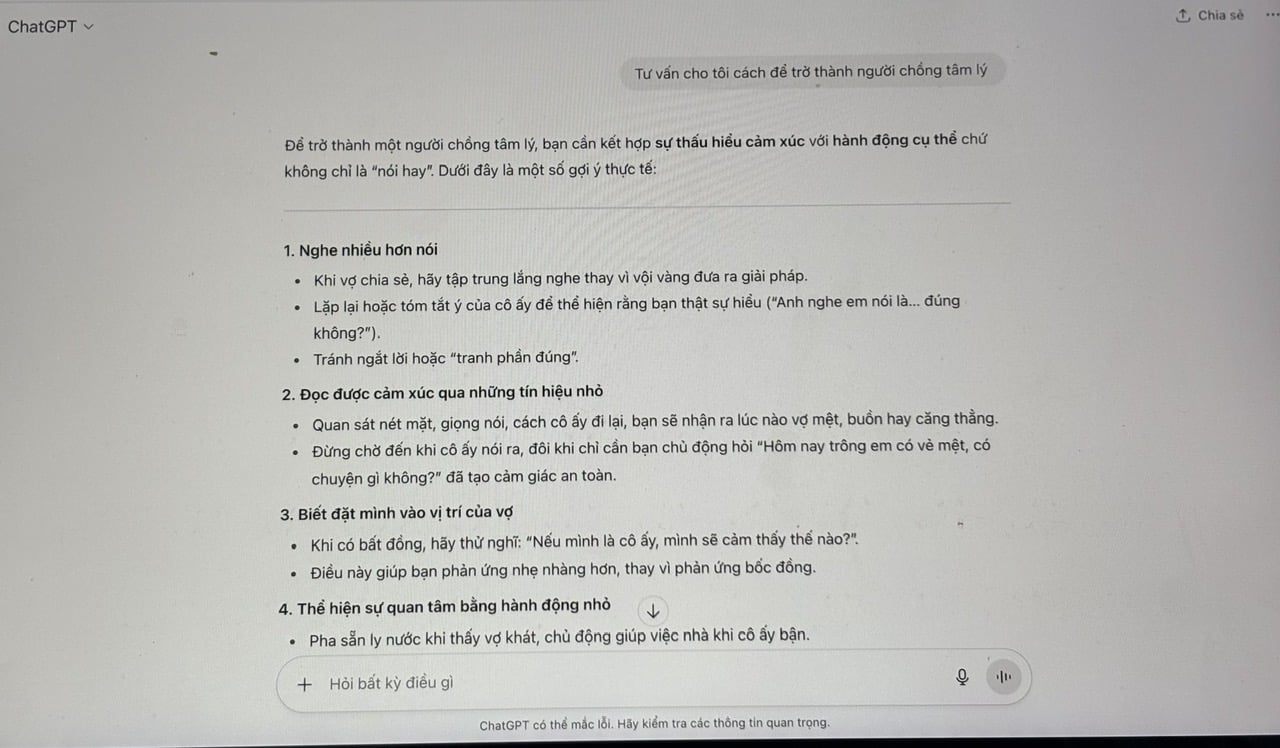

Chị Cao Thuỳ Tâm (28 tuổi, Hà Nội) kể rằng cô phát hiện chồng mình thường trò chuyện hàng giờ với ChatGPT từ học cách làm chồng tâm lý, cho tới lựa chọn quà tặng vợ hay khi có khúc mắc trong đời sống.

“Nghe qua tưởng dễ thương, nhưng với tôi, đó là cú sốc. Thay vì hỏi tôi, lắng nghe tôi nói, anh ấy lại đi hỏi một cỗ máy. Tôi cảm thấy mình không còn là một phần trong đời sống nội tâm của anh ấy nữa”, chị Tâm bộc bạch.

Tương tự, chị Nguyễn Thanh Vân (ở Hưng Yên) nhờ em gái Thanh Vi xem giúp thủ tục làm sổ đỏ ở tỉnh. Do bận rộn, Thanh Vi không thể giúp nên nhờ chồng hỗ trợ, nhưng lại không hỏi trước anh. Chị Vân sau đó cảm thấy bị phiền hà và trách móc em gái. Khi Thanh Vi đem chuyện hỏi ChatGPT, cô nhận được câu trả lời rằng “chị bạn kém hiểu biết, thiếu thông cảm”. Từ đó, hai chị em cạch mặt nhau.

Không kém phần căng thẳng, Tuấn Phạm (Hà Nội) cũng thú nhận từng tranh luận gay gắt với bạn gái chỉ vì đưa lời khuyên của ChatGPT vào cuộc trò chuyện. “Người yêu tôi buồn, tôi chụp màn hình nguyên văn đoạn ChatGPT bảo ‘nên để người ấy có không gian riêng để lắng nghe nhu cầu cảm xúc của chính mình’. Ngay sau đó, cô ấy nổi giận, nói rằng cô cần tôi lắng nghe chứ không phải một đoạn văn từ AI”, Tuấn kể.

Giao tiếp không chỉ là lời nói, ChatGPT không thay thế được

Theo chuyên viên Tâm lý – Tham vấn Ánh Đặng, mối quan hệ rạn nứt bởi ChatGPT là vì công cụ này không thể hiểu hết chiều dài và bối cảnh mối quan hệ. Khi hỏi máy, người dùng thường tập trung vào góc nhìn chủ quan để bảo vệ ý kiến của mình, từ đó AI khó đưa ra đầy đủ thông tin. Kể cả khi mô tả đủ, ChatGPT vẫn không thể nắm trọn yếu tố phi ngôn ngữ – thứ chiếm tới 93% giao tiếp, như ánh mắt, cử chỉ, điệu bộ, giọng điệu – trong khi ngôn ngữ chỉ chiếm 7%.

Trong giao tiếp, đặc biệt là với gia đình hoặc người thân, nội dung chỉ là một phần, còn thái độ và cảm xúc mới là yếu tố quyết định. Chính thái độ này có thể dẫn tới mâu thuẫn và rạn nứt. Vì thế, cảm xúc và những yếu tố phi ngôn ngữ luôn cần được quan tâm.

Khi tham vấn tâm lý, chị Ánh thường gặp trực tiếp hoặc gọi video để quan sát cách thân chủ đi đứng, ăn mặc, chải chuốt, ánh mắt, tư thế … Những điều này ChatGPT hoàn toàn không thể biết.

Giao tiếp ngôn từ cũng có nhiều tầng. Đơn giản, một hỏi câu như “Em ăn cơm chưa?” có thể chỉ là lời hỏi thăm; cũng có thể hàm ý trách móc “Anh biết, em luôn như thế, đến sức khoẻ của mình em còn chẳng để ý”; hoặc là sự quan tâm “Anh lo cho sức khoẻ của em, ăn nhiều vào cho khoẻ nhé!”.

Câu nói trên có khi thể hiện thái độ coi thường, khinh bỉ; nhưng cũng có khi là sự quan tâm ấm áp. Ý nghĩa của nó phụ thuộc vào tông giọng, nhịp điệu, sắc thái biểu cảm, ngữ cảnh… Cùng một câu, nhưng lúc có thể là đùa, lúc là thật, khi lại trách móc, lúc thì mỉa mai.

Cuối cùng, chuyên viên tâm lý – tham vấn Ánh Đặng nhấn mạnh, dùng ChatGPT để phán xét hoặc kết luận ai đúng ai sai là cực kỳ nguy hiểm, vì nó dễ bỏ qua hàm ý và cảm xúc ẩn phía sau, dẫn tới nhận định sai lệch và làm tăng cơ chế phòng vệ. Từ đó, mối quan hệ ngoài đời thực dần bị huỷ hoại.

“Công nghệ chỉ nên là công cụ hỗ trợ, còn sự thấu cảm, lắng nghe và trò chuyện trực tiếp vẫn là cách giải quyết mâu thuẫn hiệu quả nhất và là nền tảng gắn kết bền lâu”, chị Ánh nhắn nhủ.